课堂笔记 - 深度学习 Deep Learning (11)

- Gradient Descent – one weight with Bias

上篇的说明当 b=0 时该如何校正w的, 其实基本上大同小异,都是用相同的方式去校正w

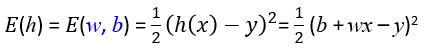

当 b!=0 的时候公式会多个b在算距离的时候先做加减:

一样对E(w,b)作偏微分,只需要注意不要微错就好:

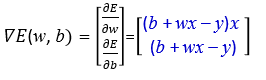

梯度训练公式:

- Gradient Descent – more weight with Bias

多个属性的梯度下降跟单个属性差不多,虽然看起来突然复杂了一点,过程跟流程都跟上面的步骤一致。

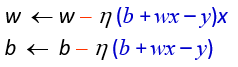

假设有M个属性:

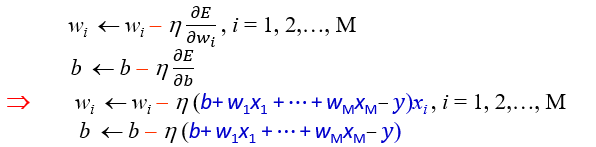

一样对E(w1,w2,w3,...wM,b)作偏微分:

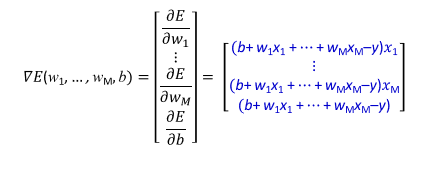

多属性的训练公式:

- Gradient Descent Algorithm的补充

同时被称为:

- Delta rule

- ADALINE rule

- Widrow-Hoff rule

在回归问题时可拥有无限输出量的值,在分类问题时可以输出有限的值。

Regression: with numeric output label(s) >> an infinite number of values

Classification: with nominal output label(s) >> a finite number of values

>>: 课堂笔记 - 深度学习 Deep Learning (12)

Day 20:1566. Detect Pattern of Length M Repeated K or More Times

今日题目 题目连结:1566. Detect Pattern of Length M Repeate...

队列

某些较耗时的工作像是寄信、发通知等,如果卡在处理请求的过程中的话就会造成使用者要多等上数秒才能收到回...

Fluentd Bit

在 Fluentd Bit 中可以使用 read 或 socket 方式处理日志 read 用於读容...

[Day-8] if判断条件式

今天要来练习的是新东西~ 就是「if、else 条件判断」 在程序里面使用if条件判断 可以让程序有...

Windows Event探索练习--开关机和Office的大小事件

今天要来研究一些常见的事件,来看看有那些东西会被系统纪录下来,他们的意义又是什麽。 笔者查了查发现不...