模型架构--1

GoogLeNet

Google提出的GoogLeNet,层数比较多,运算的效率相当好,超参数数量比Alexnet少了12倍,准确率却提升。

使用Inception,针对输入资料同时进行不同filter尺寸的卷积处理和max pooling,最後再进行级联,让每一层的特徵值取得不同大小的特徵,速度也加快许多。

ResNet(Residual Neural Network)

特色是神经网路不须每一层网路都走过,可以用跳跃的方式略过某些层数。

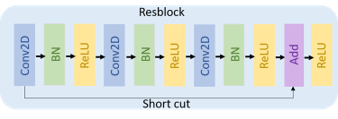

residual block

认为模型层数深,会增加Gradient Vanishing发生的问题,进而影响模型收敛,後来使用batch normalization来解决,结果显示一般深度网路层数越多,训练误差不降反增,但会出现degradation的问题,随着层数增加,导致过高的训练误差。

可以略过其中的网路架构,使用这个网路的优点可以避免模型的过度拟合,模型可以透过深层特徵和浅层特徵结合在一起进行判断,同时梯度不容易消失。

Day 8 : 案例分享(3.1) 会计模组-基础科目及传票、报表

案例说明及适用场景 会计流程,以其性质来说,应算是通用流程,藉案例分享,让大家认识如何使用 Odoo...

Day17 决策树实作

https://github.com/PacktPublishing/Machine-Learni...

【面试】技术与专案问答

刚回台北好累rrr 自我介绍後通常会先问一些简答题, new grad 可能会有一些基本 CS 知...

[用 Python 解 LeetCode] (001) 27. Remove Element

题干懒人包 输入一个数组及一个数,最後输出一个数值代表非重复数值的数量,然後以下几点要注意: 只能修...