课堂笔记 - 深度学习 Deep Learning (4)

理解机器学习的过程後,来实际理解它的演算法吧 :)

上篇所提到的Linear Model中最为基础的演算法就是PLA,大陆那边翻译名字叫感知器

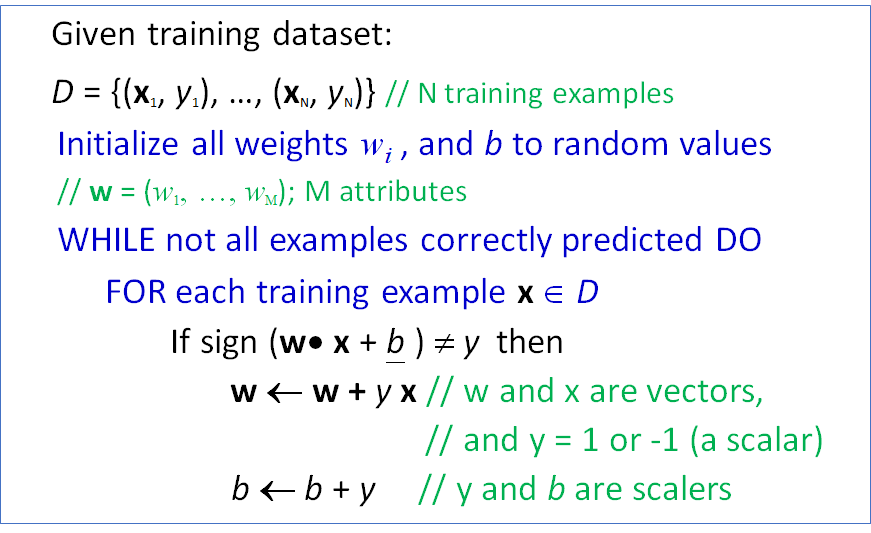

- Perceptron Learning Algorithm (PLA)

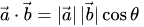

首先正式进入数学公式以前必须得先提到高中曾经学过的向量内积,

大家都知道cosΘ是震荡在1跟-1的函数(cos0° = 1,cos180° = -1),

而利用的就是Θ这个角度去判断资料点的位置跟一开始假设的那条线的法向量斜率做内积後得出每个点和线的角度关系。

然後用每一个资料点和线的角度去判断是否有成功分类,如果中间没有分类成功则再跟每个资料点跑一次。

首先PLA的第一步就是随便取一条线

w1 x + w2 y > threshold(门槛) //门槛:资料要大於某个数值才有意义 没给数字就取0

然後把输入的资料X[x1,x2]跟w1,w2做内积,得到 w1*x1 + w2*x2 - thresold > 0

因此可以获得线性方程序:h (x) = sign ((w1 x1 + w2 x2) - threshold) //sign:逻辑函数

令b = -threshold, h(x) => h (x) = sign ((w1 x1 + w2 x2) + b)

- 如何改正分类错误

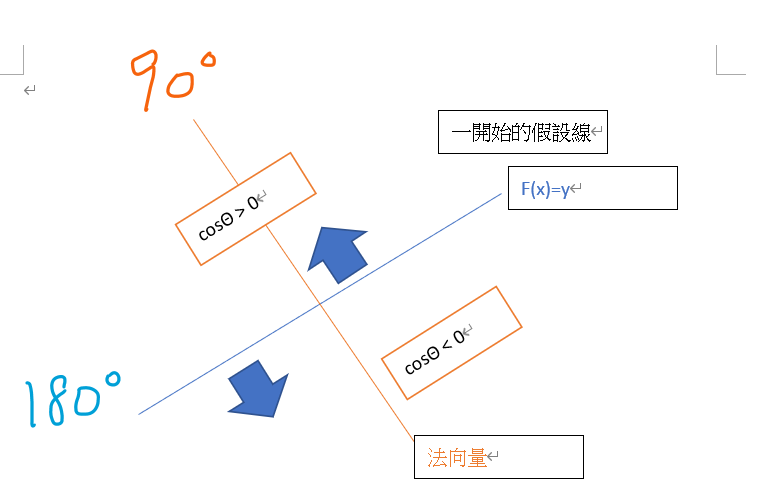

错误1:输出的y是1,但是h(x)的结果是-1

W[w1,w2] = W + yX => W = W + x

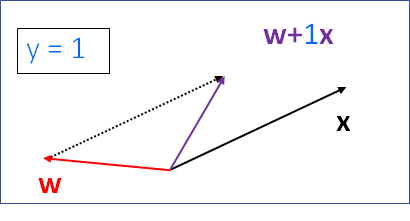

错误2:输出的y是-1,但是h(x)的结果是1

W[w1,w2] = W + yX => W = W - x

程序流程图

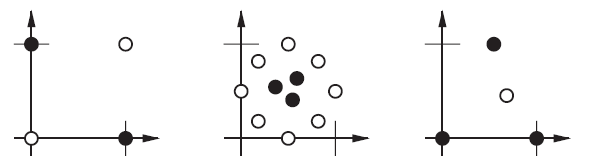

- PLA的缺点

1.PLA不能解决线性不可分割的例子:

2.单层的PLA只能对输入进行线性分类

<<: 课堂笔记 - 深度学习 Deep Learning (3)

Day15 无障碍功能

无障碍网页是什麽 首先来介绍无障碍网页的概念,无障碍网页并不只是像我们生活中常听到的无障碍厕所、无障...

Day 17:AWS是什麽?30天从动漫/影视作品看AWS服务应用 -《ExMachina》

《ExMachina》台湾译作《人造意识》,比起译名更喜欢维持原文的ExMachina称呼,从Deu...

DAY26 - 未完成的第六个范例POS系统网页版

前言 今天是铁人赛第二十六天也是ON档的最後一天,後面天数的文章都写完了 原本昨天可以顺便把这篇写完...

[Day02] 第二章- 初探金流API文件-1

前言 今天会分享我的阅读api心得 并做简易的操作来使用今天研读後的成果 前几日会以阅读文件跟熟悉永...

Day 16 「听从你的蜥蜴脑」单元测试、Code Smell 与重构 - If 篇

你有听过「蜥蜴脑」吗?如果你读过 The Pragmatic Programmer,你应该还有印象。...