Neural network基础架构

Nertal network(NN)的概念其实很早就发明出来了,但直到1986年backpropagation应用在NN做出很好的结果之後才开始被大家重视,今天就来讲一下NN的基本架构:

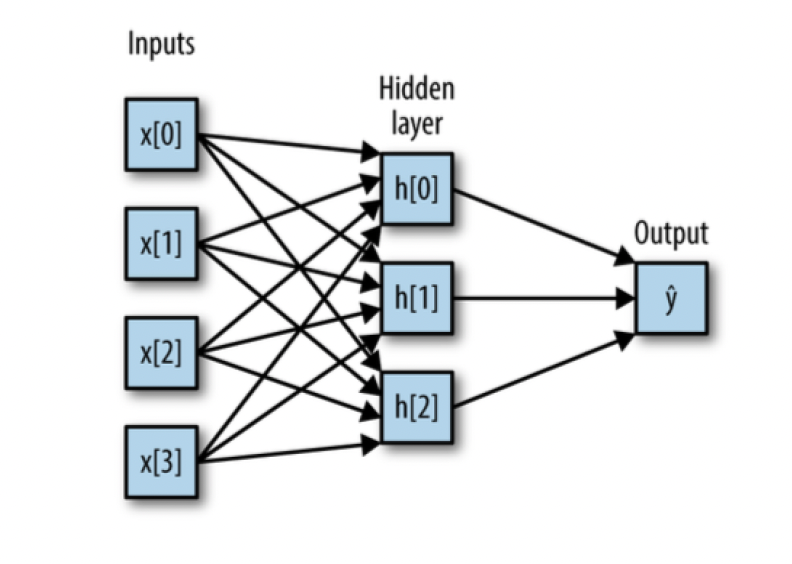

基本来说NN主要会有三层架构:input, hidden layer, output。input也就是我们放入的训练资料,以上图来说资料有四个features(predictors),hidden layer是整个NN的核心,我们可以自由决定要有多少层hidden layer以及每一层要有几个nodes,以上图来说我们只有一层hidden layer,之中有三个nodes(h[0],h[1],h[2]),最後的output就是我们的预测值(y hat)。

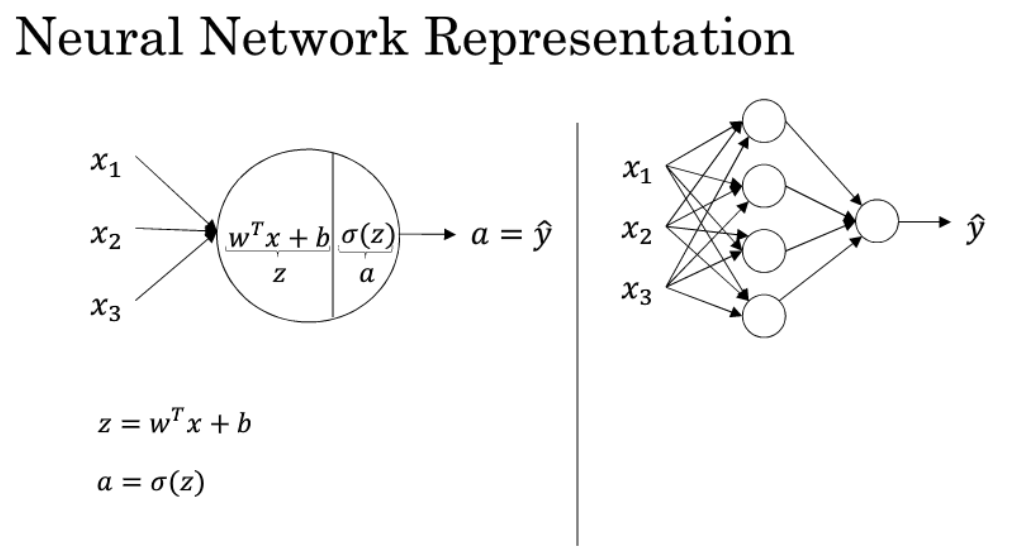

在每一个hidden layer里都会包含linear和non-linear的方程序(你可以把它想像成一个三明治,间单只看一个结的的话就会长的如下左图:

z的部分就是linear,而sigma则是non-linear。wT是transpose,可以把它当成简写就好,全部展开就是z= w1x1 + w2x2 + w3x3 + b;non-linear又称为active function所以很常简写为a,在非线性的部分我们可以有很多选择,像是tahn, sigmoid, Relu, leaky Relu,可以发现如果选择sigmoid的话每个node就会是一个logistic regression~

NN的重点就是在把w和b优化,找出最小的cost function,cost function也有很多种,他的概念就有点像我们一般在做回归问题时衡量的MSE,有就是预测与实际的差距拿去加总再平均,而找出最佳的w和b的方法就是我们之前提到的gradient descent。

[reference]

https://www.slideshare.net/ccckmit/ss-69447809

http://wiki.hacksmeta.com/machinelearning/deeplearning/neural-networks-basics.html

<<: Spring Cloud Netflix Eureka 简介

>>: #20 No-code 之旅 — Analytics ft. Google Analytics & Splitbee

【资料结构】赫序

赫序 静态赫序(static hashing) 静态赫序组件 赫序表(Hash table,ht):...

[iT铁人赛Day15]JAVA更多的回圈

今天要来介绍的也是回圈 一个更好用的多重选择-switch叙述 当程序有较多的叙述,有较多的选择时,...

[第17天]理财达人Mx. Ada-股款交割

前言 本文说明查询帐户股款交割资讯。 程序实作 程序 # 股款交割 settlements =api...

【在 iOS 开发路上的大小事-Day09】将常用的 Function 写成一个 class,让各个档案都能使用

在开发上,常常会有一些 Function 是会在各个档案中使用的,如果每次都要在需要用到这个 Fun...

Day 1 - 参赛需要一个序

背景故事 年初的时候,看到公司长官在 FB 分享的可爱铁人赛贴纸,长官说,想要可爱贴纸那就自己来报名...