Day 23: Recurrent Neural Network — 循环精神网路初探(下)

Recurrent Neural Network 循环精神网路

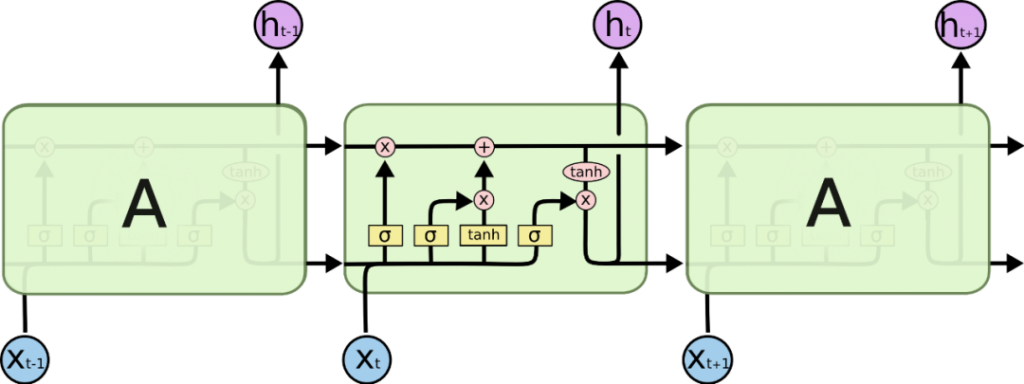

前面讲述了许多关於RNN循环精神网路的优点,不同於一般精神网路的优点,甚至比一般精神网路还要好的能力,却不代表他没有缺点。

RNN的致命缺点

梯度消失问题(Vanishing gradient problem)

梯度消失问题是一种机器学习中的难题,出现在以梯度下降法和反向传播训练人工神经网路的时候。在每次训练的迭代中,神经网路权重的更新值与误差函数的偏导数成比例,然而在某些情况下,梯度值会几乎消失,使得权重无法得到有效更新,甚至神经网路可能完全无法继续训练。

而为什麽RNN会发生梯度消失的问题呢? 这就是因为他训练的方式是使用Back Propagation Through Time。因为小空间的历史资讯太长了,RNN所使用的训练方法并不是之前所提到的反向传播法(BP, Back Propagation),而是进阶版本的Back Propagation Through Time,与BP不同的地方就在於BPTT是透过时间来进行训练的。

资料参考:

https://www.gushiciku.cn/pl/p5ok/zh-tw

https://zh.wikipedia.org/wiki/%E6%A2%AF%E5%BA%A6%E6%B6%88%E5%A4%B1%E9%97%AE%E9%A2%98

<<: Day13 - 【概念篇】OAuth flows: Password Grant (Legacy)

Day26 Bootstrap建立网页

昨天我们利用Bootstrap的框架做了一个三栏的版面,而今天我们就是要利用Bootstrap不同的...

Day6-我通知你的通知通知我!!!(无误!

标题那个还真的是没有写错~ 且听我细细道来~ ------------------------ 【一...

【2】学习率大小的影响与学习率衰减(Learning rate decay)

Colab连结 大家应该听到烂了,学习率(Learning rate)指的是模型每做完一次 back...

【Day3】前端React +Antd 的环境(Docker化)建立 (上)

1.前端的建立过程(上): 我是在本机电脑运行起来本地版本 Container 的静态前端 Serv...

Day39 ( 电子元件 ) 人体红外线侦测

人体红外线侦测 教学原文参考:人体红外线侦测 这篇文章会介绍如何使用 micro:bit 连接人体红...