[Day28] BERT(一)

一. 介绍

Bert全名为Bidirectional Encoder Representation from Transformers,目前Bert与其他以BERT为基底的模型都还是目前的主流模型之一,各位可以参考SQUAD2.0: https://rajpurkar.github.io/SQuAD-explorer/ 有需多为BERT衍生的模型所以BERT是非常重要重要的工具

二. 模型架构

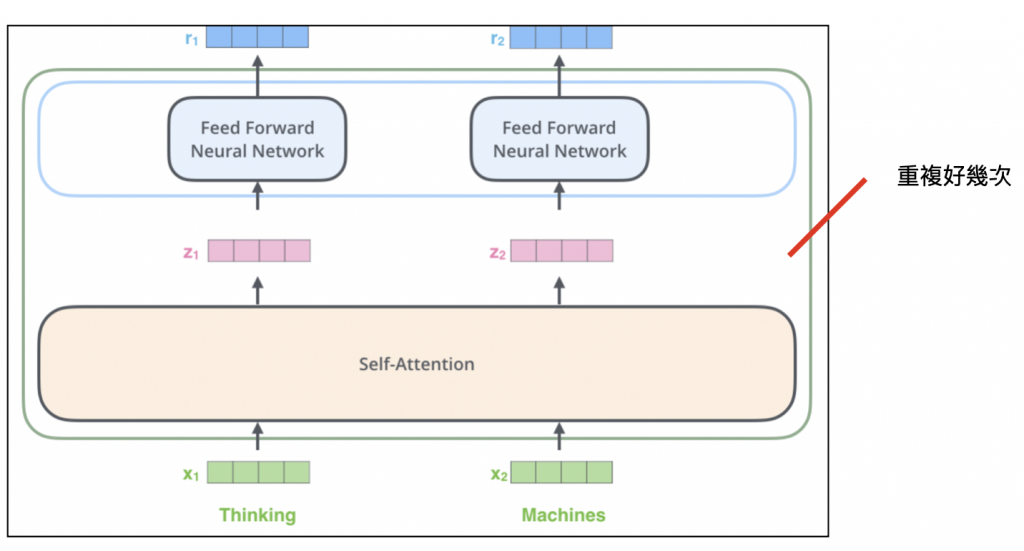

从英文全名来看,BERT就是Transformer的encoder,他就是下图self-attention叠了12层的样子:

模型架构就是跟transformer的encoder一样,BERT的目的就是为了得到好的句子编码~~

三. 训练

接者来说说他的训练原理,他分为2个训练:

- 掩码语言模型(Masked Language Model):

这个任务可以看成'克漏字填充',随机将一个句字中的一些词转换成[Mask]这个标记,但这些标记为[MASK]的词大约占10%。

以一个句子来说,如果原句是"我今天很帅",那麽可能会调整成 : 80%的 "我今天很[Mask]" + 10%的 "我今天很帅" + 10%的 "我今天很情",藉由调整不同频率的句子,让BERT学会了解句子。

- 後续句预测(Next Sentence Prediction):

在这个训练任务中,主要是让 BERT 去理解 NLI (蕴含推理,判断上下句间是否为相连)任务,因此需要输入前後不同的两句。像是'海水退了'与'就知道谁没穿裤子',这2句就是相连的句子~~

以上就是BERT简单的介绍,明天会开始实作~~

((我知道最近内容真的很少QQ,未来会慢慢补齐的

>>: 30-13 之 Domain Layer - Table Module

arduino函式库的安装与使用

大家好今天要继续介绍arduino函式库安装与使用 arduino IDE本身会有内建一些函式库让你...

[Day30] 结语

好的,各位恭喜您也恭喜我,终於熬过了这段时光,说实在一个月,说长不长,说短也不短,持之以恒,唯其艰辛...

[iT铁人赛Day3]JAVA的键盘输入

有些程序码会在输入之前就先设定好变数值 然後直接执行程序 那如果想要自己输入变数值,然後看看程序码执...

Day 13 (Ai)

1.上排工具 1.物件>封套扭曲 a.以弯曲制作>鱼眼 b.以上层物件制作 => ...

[DAY21] 用 Azure Machine Learning SDK 建立运算资源

DAY21 用 Azure Machine Learning SDK 建立运算资源 资料集也建立完成...