[Day 13] 从 tensorflow.keras 开始的 EfficientNet 生活

0. 进度条

| 模型 | 进度 |

|---|---|

| VGG Net | 完成 |

| ResNet | 完成 |

| DensNet | 完成 |

| MobileNet | 完成 |

| EfficientNet | 此篇 |

0.1 前言

你遇过以下几种困扰吗?

0.2 回忆当年...

在我初学神经网路的时候,

只会暴力地把模型加深,

然後期望梯度下降法帮我解决所有问题。

因为那时大家都在这麽做。

:喂喂 你能解决梯度消失的问题吗?

:好像可耶

:太棒了! 我们再加深100层。

(ResNet-1001表示)

但是,Mingxing Tan 和 Quoc V. Le完全看不下去,

他们觉得现在大家疯狂地加深网路根本拿石头砸自己的脚,

就算Google研究团队发表了一个1000万层的网路,

然後说它有多好、多棒。

事实上,像你我一样的小小研究员或是民间小公司,

根本就不可能有那样的运算资源去训练出跟Google一样好的模型。

更别说他们有一堆我们拿不到的Data。

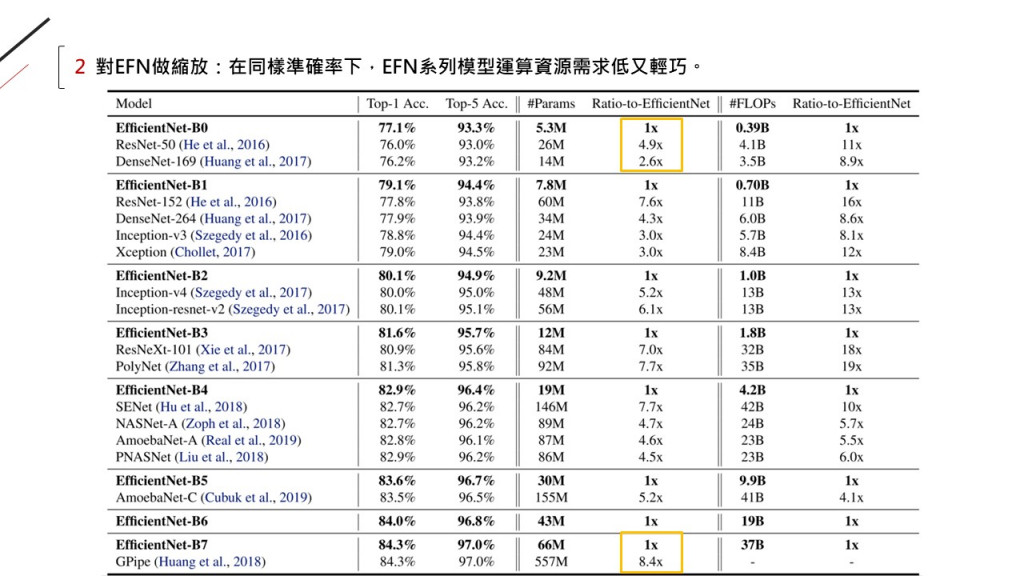

所以Mingxing Tan 和 Quoc V. Le重新思考模型缩放(Model Scaling)的意义,

然後提出一个超高效(efficient)的模型架构。

1. EfficientNet

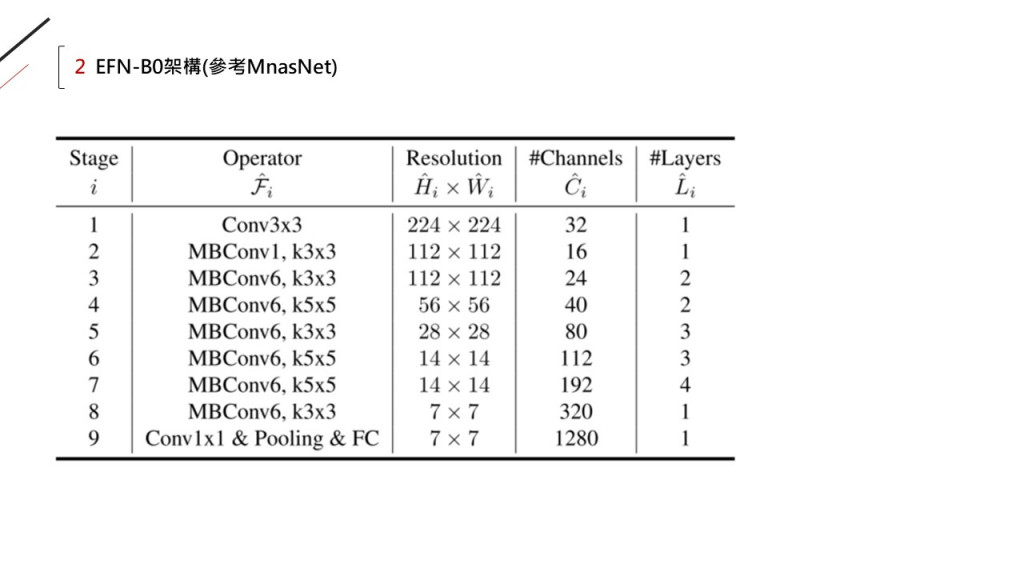

这是EfficientNetB0架构,是B0~B7中最小的:

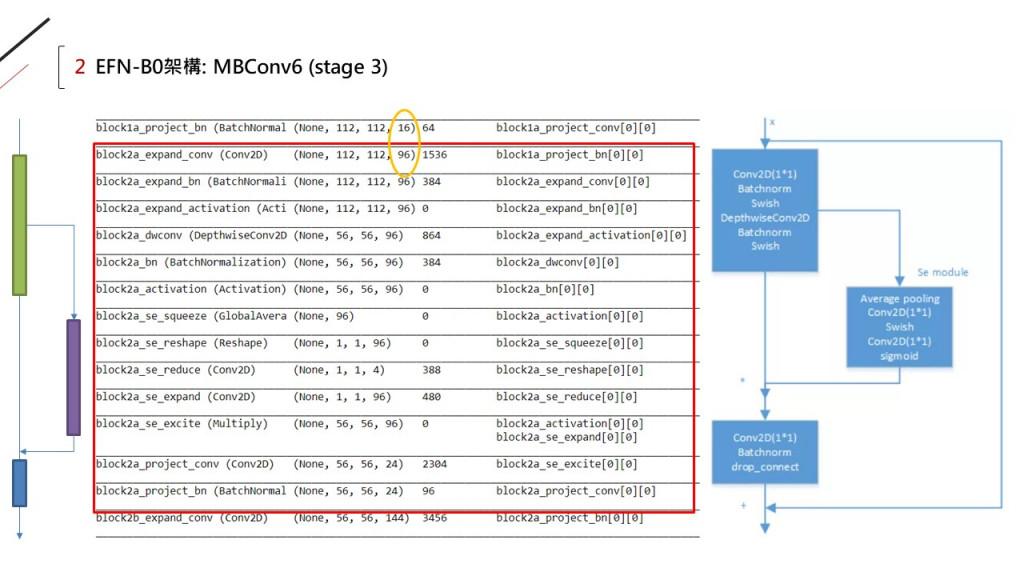

其中的MBConv6就是这个结构(如右图):

"6"代表的是扩张通道数"6"倍。

从MBConv的结构可以看出它参考了深度可分离卷积和直连通路的设计,

其实就是「M」o「B」ileNetV2的基础架构啦:

- 借监MobileNetV1: MBConv先透过PW卷积扩张通道数,再透过DW卷积和ReLU进行激活。

(为何要扩张: 有一说是因为低通道数的特徵图不适合使用ReLU激活) - 借监ResNet: 在layer input和layer output中间建立直连通路。

- 调整输出通道数: 透过PW卷积调整想要的通道数

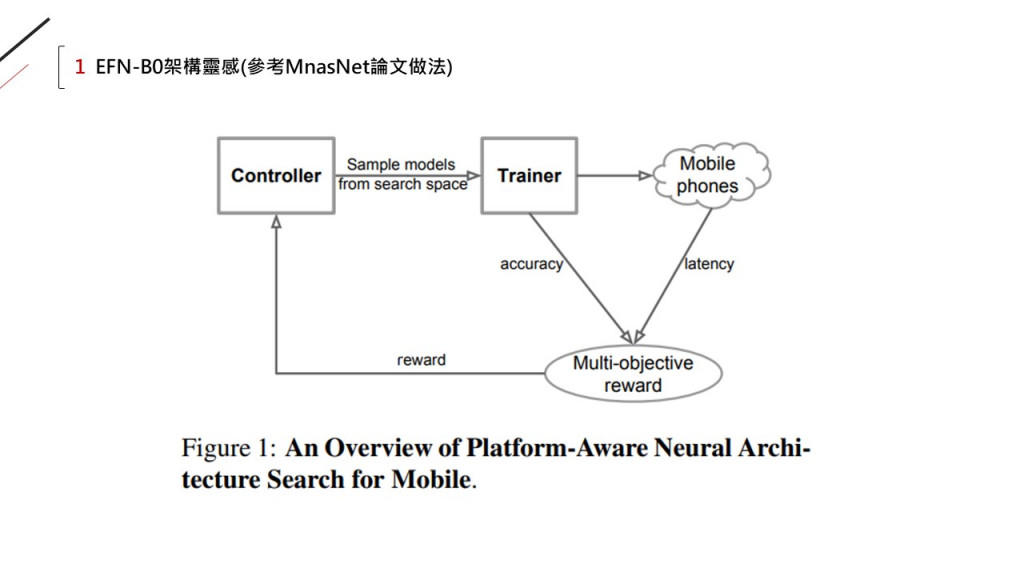

1.1 神经网路架构搜寻(Network Architecture Search, NAS)

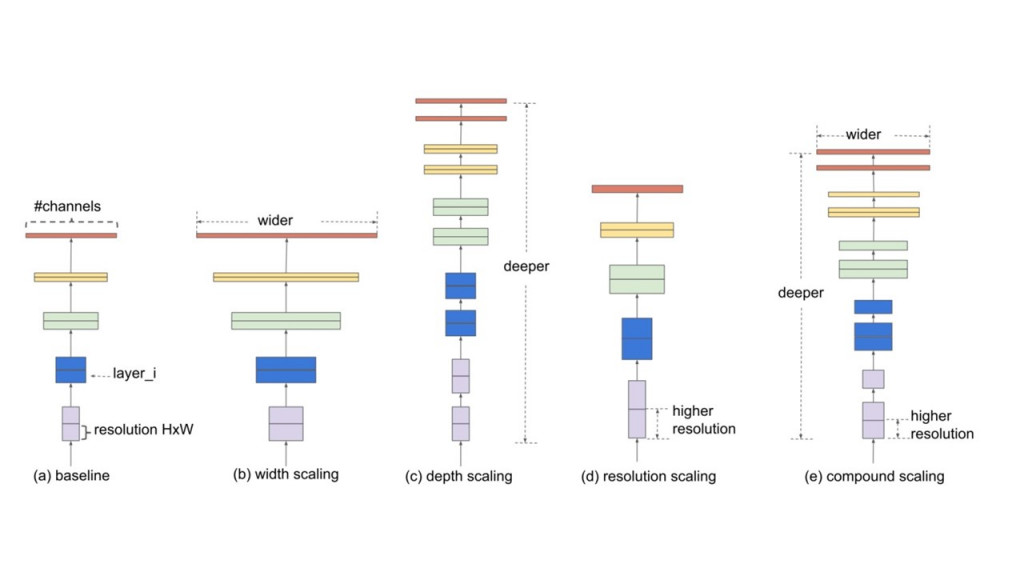

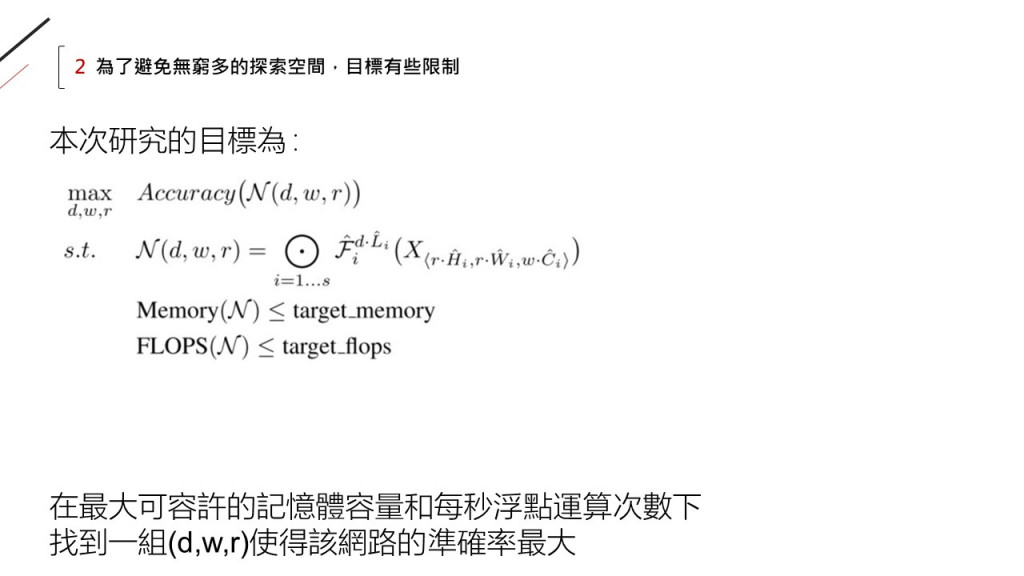

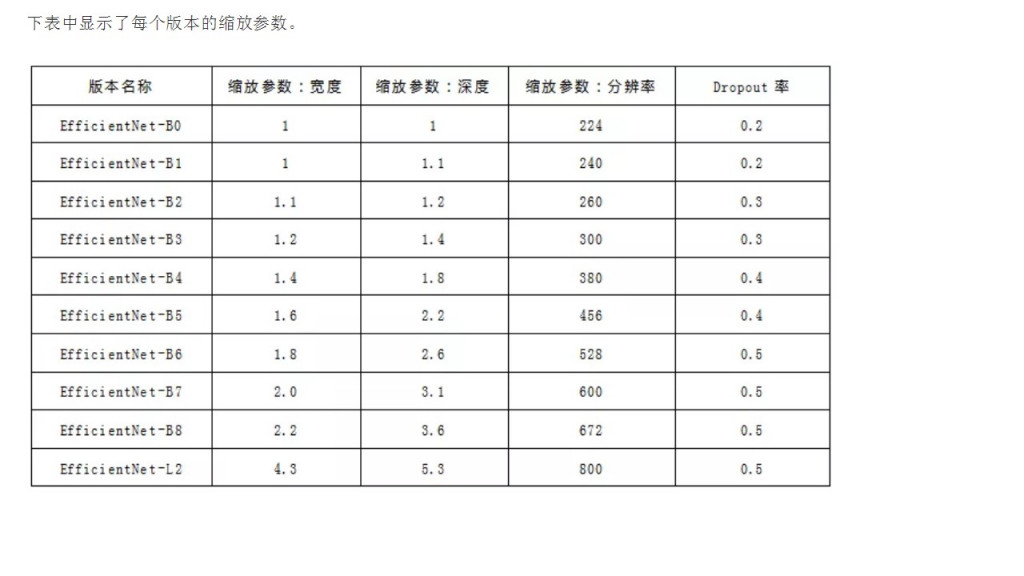

1.2 模型缩放

有三种方向做模型缩放:

- width: 卷积层通道数

- depth: 网路层数

- resolution: Input解析度

- compound scale: 混合缩放(此篇论文提出)

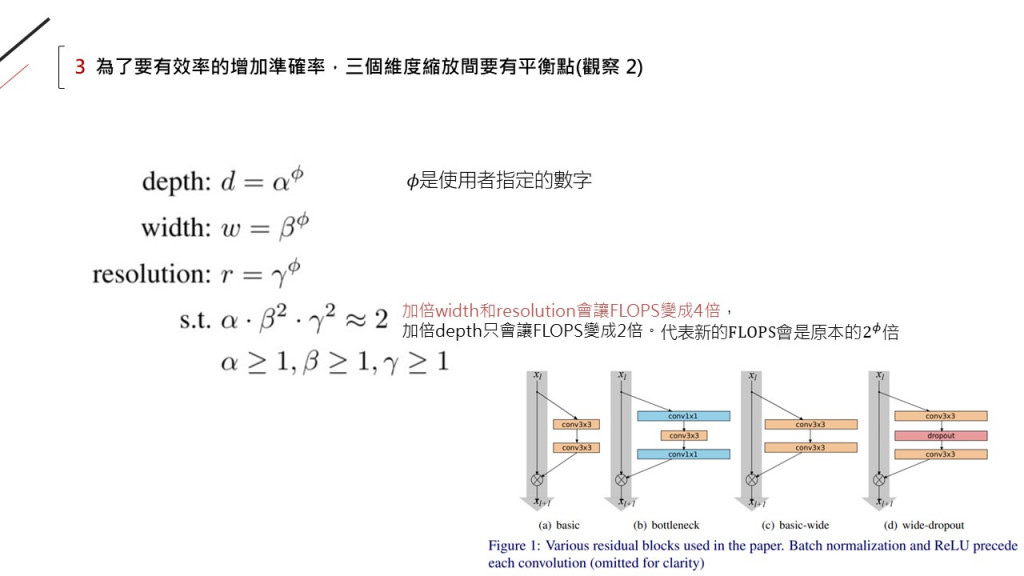

1.3 如何同时对三个方向做缩放?

此论文提出一个方程序,

由4个参数组成:alpha, beta, gamma, phi,

分别代表depth, width, resolution和指数。

换句话说: 此方程序限制了三方向缩放的比例,

根据这个比例缩放的模型,

是最高效率的缩放方式!

![]()

OS:

限制缩放比例也蛮合理的,

假如宽度、深度和解析度分别代表人类的头、身体和脚掌,

那我们从小长到大绝对不会只长大一个部位,

如果我们头大身体小,那一定很不健康。

但是以前的模型真的就是在深度上往死里加大 XD

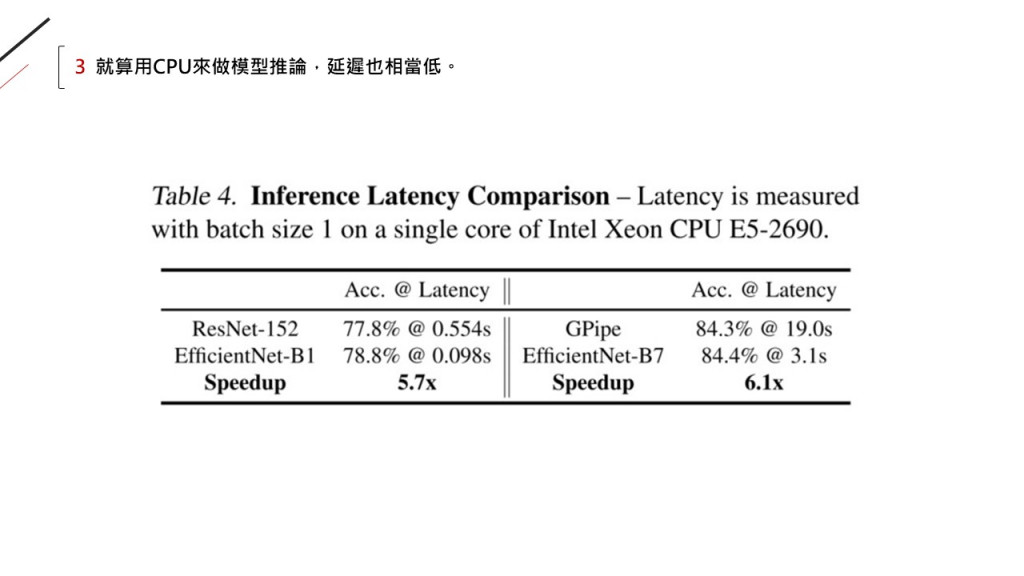

1.4 为什麽说是高效率的?

因为被拿来放大的模型(B0),

本身是在最佳化问题下用NAS找到的:

2. 结语

2.1

2.2

2.3

3. 附录

图片来源:https://www.jianshu.com/p/5449ce4de7cc

3. 参考资料

- https://arxiv.org/abs/1905.11946

- 这篇有大量投影片截图,因为之前我有做简报介绍EFN,所以就直接拿来用了。

<<: Day 13: 人工智慧在音乐领域的应用 (AI作曲的历史发展)

2. 工程师不只是工程师

前言 我自己觉得这篇跟leadership比较没有关系,感觉蛮适合给正在寻找下阶段目标(但不一定要...

ISO 27001 资讯安全管理系统 【解析】( 十三)

陆、第五章 领导统御 成功的ISMS是由上而下实行的,透过考虑利害关系者的要求及采取有效控制措施将营...

资料取得 - 多重来源

说是多重来源,其实也就是本机和 shioaji 而已,我的想法是这样子的,如果本机有资料的话,就从本...

Day12-D3 的 Tooltips

本篇大纲:tooltips 基础设定、tooltips 进阶应用 今天我们要来讲解算是D3最轻松简...

全通路发展个人品牌-笔记

出处来自FB畅哥-全通路个人品牌 主讲者:「空姐报报」版主 Emily 为何卸下空姐的身分? 讲者是...