[Day24] NLP会用到的模型(七)-transformer encoder

一. encoder

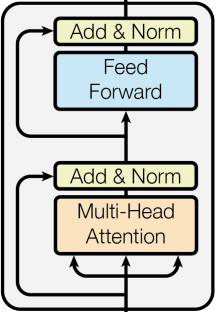

架构如下:

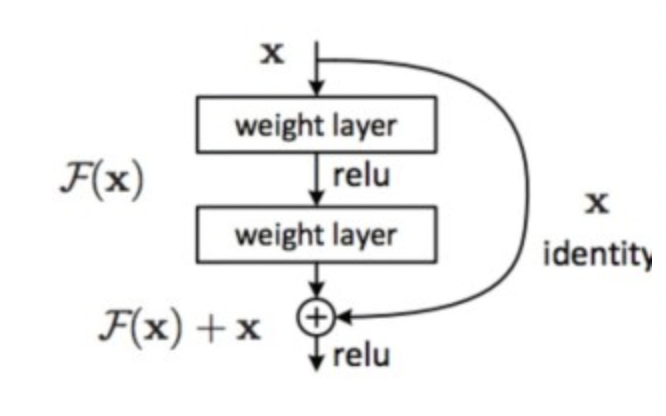

encoder的动作在於对input进行编码,在一开始input会产生Q、K、V这三个矩阵,由上图可知道,他会先进行多头的self-attention得到新的一组编码,这个地方他有多做一个处理就是残差连接(Residual connection),这边作者是用到 ResNet 的概念,能够让深度学习训练更深的网路,避免造成梯度爆炸或梯度消失,公式如下:

Residual(x) = x + Sublayer(x)

就是将经过多头 self-attention的值与原本input的值进行相加,以图示来说如下:

各位可以看上图,他有一块add&norm,add就是做上述的残差相加,norm是Layer normalization,对每一层做正规化的意思(详细部分未来再补QQ),最後残差与正规化的公式如下:

Add & Norm(x) = LayerNorm(x + Sublayer(x))

在encoder的最後最後,会将K与V(两者长一样)传给decoder,与decoder的Q做attention,明天会再介绍decoder的部分

视觉化KBARS(5)-1分k展示

前面把java跟python部分完成後, 接下来要继续写js和html的步骤来完成1分k视觉化。 (...

Day30 | 30天系列回顾 X赛程後规划

好啦,今天是第三十天了,今天会分享下赛程心得,并回顾一下前面系列文,最後是三十天後的规划! 参赛动机...

[Day18] NLP会用到的模型(二)-GRU

一. LSTM的问题 LSTM虽然非常强大,但LSTM也是有一个问题,就是计算时间较久导致执行速度较...

[第十六天]从0开始的UnityAR手机游戏开发-如何切换场景02

在Project新增Create→C# Script取名为ChangeScene 撰写程序码 usi...

[ Raspberry Pi ] Compute module 4 eMMC 烧录流程 ((CM4))

终於拿到手的Raspberry Pi Compute module 4 参考 官网 (确保电脑没有连...